微软前几日推出目前功能最强大、最具成本效益的小语言模型(SLM)Phi-3,根据实测数据,性能力压上周Meta公司推出的LIama 3 8B。

![图片[1] - 微软推开源小语言模型Phi 3,性能超LIama 3,可本地下载 - 万事屋](https://www.rei3.com/wp-content/uploads/2024/04/e1fe2856627c46e1a707db8457bf8abdnoop.image_.jpeg)

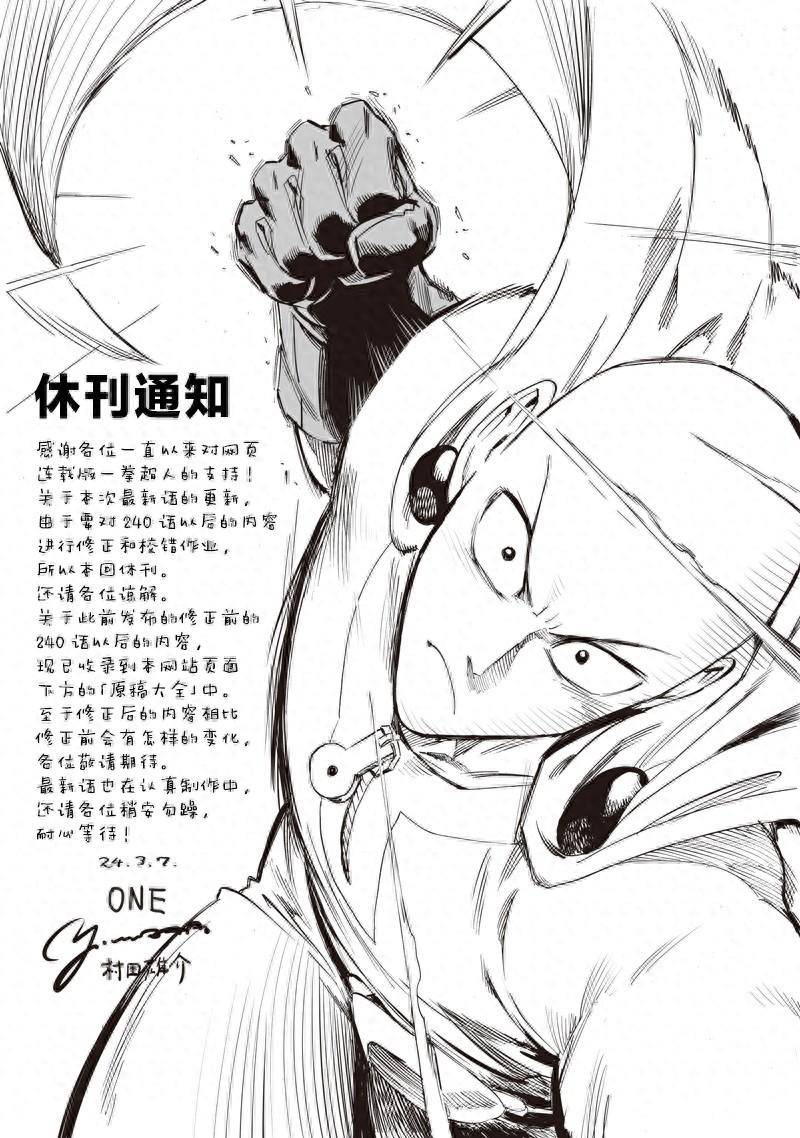

Phi-3是一款系列开源模型,最新推出的是Phi-3 mini,测量了 38 亿个参数。它有两种上下文长度变体 – 4K 和 128K Token。它是同类产品中第一个支持最多 128K 个Token的上下文窗口的模型,而且它对质量影响很小。

从今天开始,它将在 Microsoft Azure AI 模型目录、机器学习模型平台 Hugging Face 以及用于在本地计算机上运行模型的轻量级框架 Ollama 上提供。

微软人工智能副总裁 Luis Vargas 表示:“有些客户可能只需要SLM,有些客户需要LLM,而许多客户则希望以各种方式将两者结合起来。”

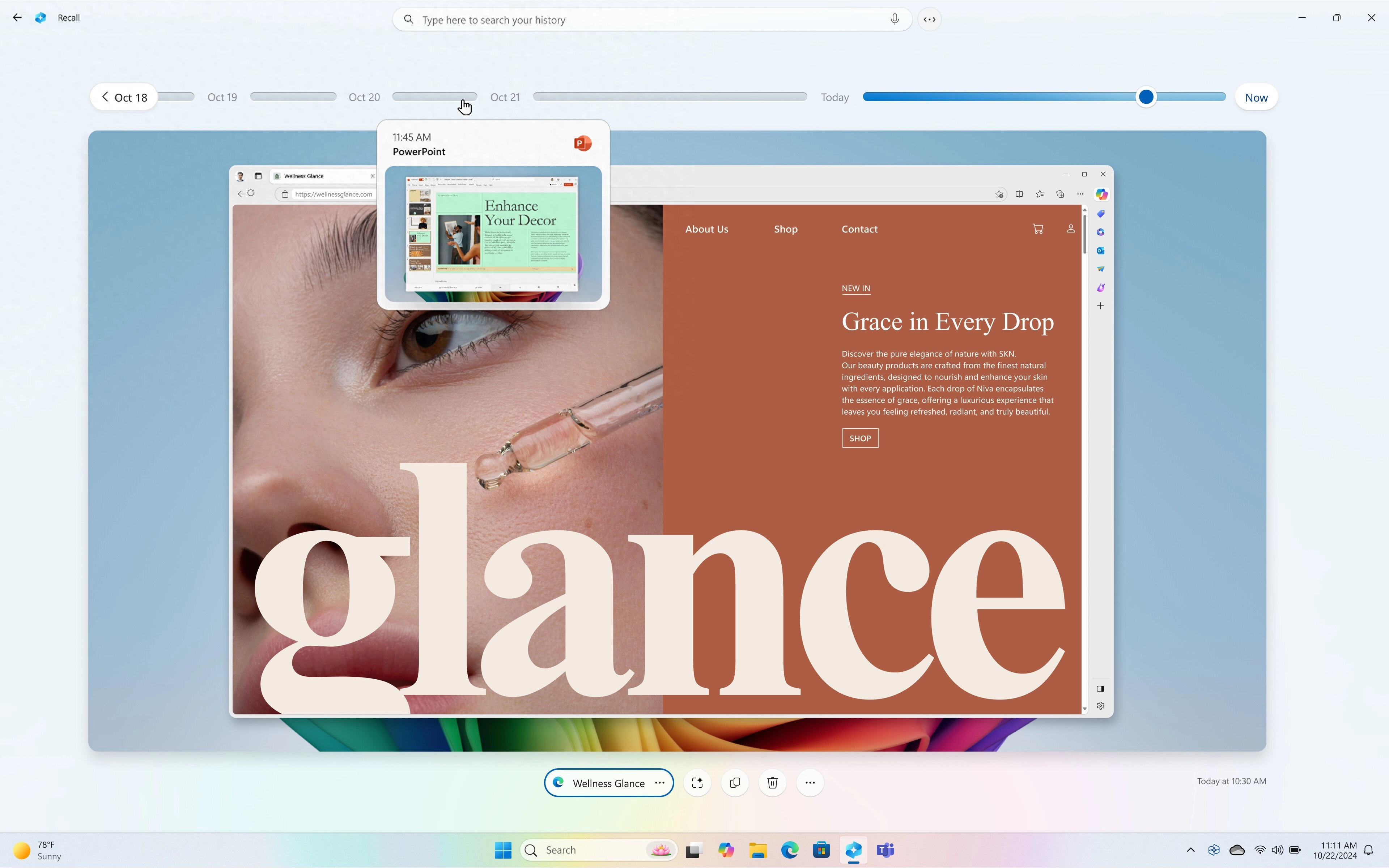

由于 SLM 可以离线工作,因此更多的人将能够以以前不可能的方式让人工智能发挥作用。

![图片[2] - 微软推开源小语言模型Phi 3,性能超LIama 3,可本地下载 - 万事屋](https://www.rei3.com/wp-content/uploads/2024/04/7e3994de902f4ad4b5ea41f0ccef2fb7noop.image_.jpeg)

微软还宣布 Phi-3 系列的其他型号即将在未来数周内推出,以在质量和成本方面提供更多选择。 Phi-3-small(70 亿个参数)和 Phi-3-medium(140 亿个参数)很快就会在 Azure AI 模型目录和其他模型园中提供。

Phi 模型源自微软研究院,已得到广泛应用,Phi-2 下载量超过 200 万次。从用于 Python 编码的模型 Phi-1 开始,到增强推理和理解能力的 Phi-1.5,再到Phi-2,这是一个拥有 27 亿参数的模型。

文是楼上发的,图是楼上帖的,寻仇请认准对象。

有些是原创,有些图文皆转载,如有侵权,请联系告知,必删。

如果不爽,请怼作者,吐槽君和你们是一伙的!请勿伤及无辜...

本站所有原创帖均可复制、搬运,开网站就是为了大家一起乐乐,不在乎版权。

对了,本站小水管,垃圾服务器,请不要采集,吐槽君纯属用爱发电,经不起折腾。

暂无评论内容